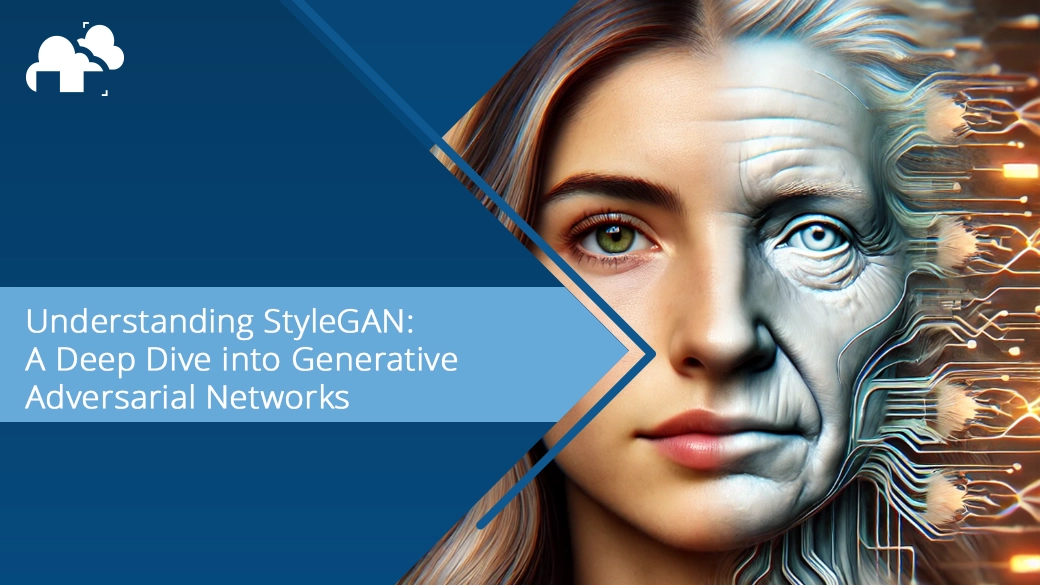

StyleGANとは?生成的逆数ネットワークについて

StyleGANは、NVIDIAが開発した高度なAIモデルで、さまざまなスタイルや特徴を正確に制御しながら、非常にリアルな画像を生成することができます。これはGenerative Adversarial Networks (GANs)をベースとしており、コンピュータグラフィックス、デジタルアート、3Dコンテンツ制作などの分野に大きな影響を与えています。StyleGANを使用することで、アーティストや研究者は高品質なAI生成画像を作成することができ、クリエイティブな用途と技術的な用途の両方で強力なツールとなります。

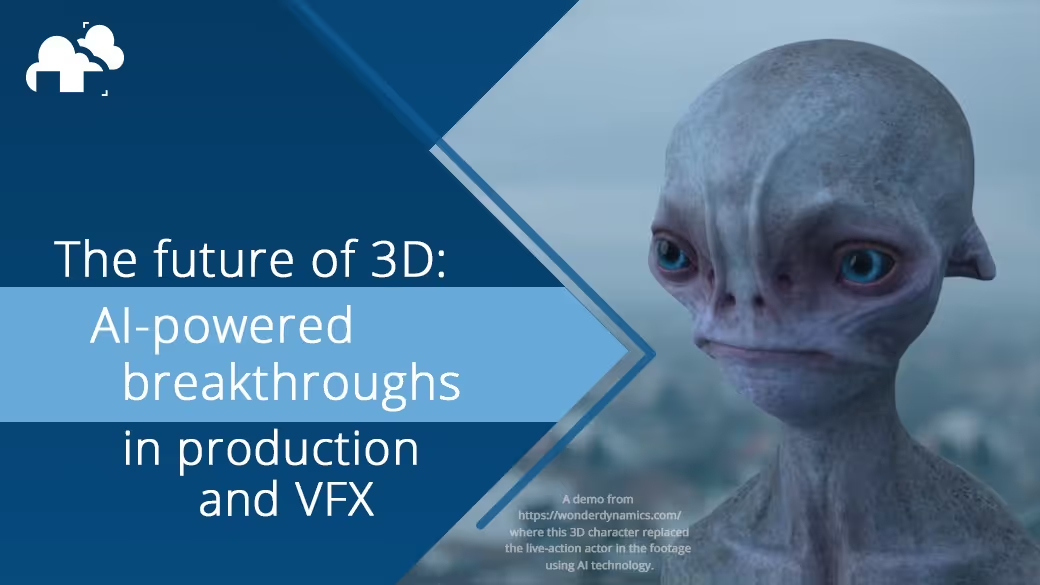

StyleGANの最も魅力的な活用法のひとつは3Dモデリングで、テクスチャやデザインを自動生成することで、クリエイティブな作業のスピードアップに貢献します。Blender を使用する多くの 3D アーティストは、ユニークなテクスチャやキャラクターデザイン、さらには背景要素を作成するために StyleGAN を活用しています。しかし、これらのAIが生成した要素を完全に詳細な3Dシーンに落とし込むには、多くのコンピュータパワーが必要です。そこでBlenderレンダーファームの出番です。このファームにより、アーティストはクリエイティブな作業を中断することなく、複雑な画像を素早く処理することができます。

AIが進化し続ける中、StyleGANはアーティストに新たな可能性をもたらし、デジタルアートや3Dモデリングで実現可能なことの限界を押し広げます。

StyleGANの仕組み:ジェネレーターとディスクリミネーターの構造を知る

StyleGANは、従来のGANシステムにいくつかの改善を加え、画像生成をより良く、より制御しやすくしています。ノイズ入力を1つだけ使用する通常のGANとは異なり、StyleGANはマッピングネットワーク、適応的インスタンス正規化(AdaIN)、プログレッシブ成長、パス長正則化を追加しています。これらの改良により、ジェネレーターは画像の異なる部分を個別に調整し、特徴をスムーズに変化させ、視覚的エラーの少ない高品質な画像を生成します。これは、以下のAI Bitesによる動画で紹介されているように、スタイル、テクスチャ、および顔の特徴を正確に制御できるような、より高度で柔軟なモデルを作成します:

マッピングネットワークとスタイル・インジェクション

StyleGANの最大の改善点のひとつは、従来の潜在空間(Z空間)をW空間と呼ばれるより整理された空間に変更するマッピングネットワークです。ランダムなノイズを直接ジェネレーターに送る代わりに、ノイズは8層のネットワークを通して処理され、異なる画像の特徴を分離するのに役立ちます。そして、この処理されたデータがジェネレーターの複数のレイヤーに追加さ れます。初期のレイヤーは顔の形やポーズのような大きな特徴を制御し、後のレイヤーはテクスチャーやディテールのような細部を洗練します。この階層的なスタイル注入により、画像属性の正確な制御が可能になり、異なるソースからのスタイルをシームレスに混合してブレンドすることができます。

適応的インスタンス正規化(AdaIN)

StyleGANは、従来のバッチ正規化ではなく、適応的インスタンス正規化(AdaIN)を使用することで、画像生成を向上させます。AdaIN は、入力データに基づいて平均と分散を変更することで、画像の特徴を調整します。これはネットワークの各レイヤーが独自のスタイル情報を受け取るということであり、様々なレベルでの詳細な変更を可能にします。また、AdaINでは、画像の主要構造は安定したまま、色、照明、テクスチャなどの細部を個別に調整することができます。この方法により、画像間の融合がよりスムーズになり、顔全体の形を歪めることなく微調整が可能になり、異なるスタイル間のより自然な移行が可能になります。

進歩し続ける発展

学習をより安定させ、画質を向上させるため、StyleGANは4×4ピクセルの低解像度から始め、1024×1024ピクセルのような最終解像度に達するまでサイズを倍増させながら段階的に画像を作成します。この段階的な方法により、ネットワークはまず基本的な構造を学習し、毛穴やシワなどの細かいディテールを追加する前に、顔の対称性や位置などの特徴が正しいことを確認します。解像度を徐々に上げることで、GANの学習でよく起こりがちな、モード崩壊や小さなディテールの過度な適応といった問題を回避することができます。その結果、より自然でリアルな画像が実現できるのです。

path length regularizationによるディスクリミネーター(識別器)

StyleGANは、path length regularization(パス長正則化)と呼ばれる技術によって識別器を改良し、特徴量の変化を滑らかで一貫性のあるものに保ちます。つまり、入力データのわずかな調整によって、生成される画像は徐々に変化し、予測可能になるため、急激な歪みを避けることができます。また、パス長正則化により、不要な高周波の不自然さが軽減され、異なる画像間のブレンド品質が向上するため、顔の変化がより自然に見えるようになります。変形を安定させることで、StyleGANは特にスタイルを変えたり、異なる特徴をブレンドしたりする際に、よりリアルな画像を生成することができます。

画像合成における潜在ベクトルとマッピングネットワークの役割

潜在ベクトルは生成された画像の特徴を制御しますが、従来のGANは1つのノイズベクトルが画像全体に影響するため、正確な調整が困難でした。StyleGANは、潜在ベクトルをより整理されたW空間に変更するマッピングネットワークを使用することで、この問題を解決し、異なる特徴を個別に制御することを容易にします。これにより、シェイプ、テクスチャー、カラーなどを個別に調整することが可能になります。ジェネレーターは、この変換された潜在ベクトルをさまざまな段階で適用し、Adaptive Instance Normalization(AdaIN)は、各レイヤーが固有のスタイル情報を取得することを確実にします。これにより、画像間の遷移がスムーズになり、異なるソースからの特徴が自然に混ざり合うようになります。さらに、style mixing regularization は、異なる潜在ベクトルが異なるレイヤーに影響を与え、過剰な適合を防ぎ、特徴がどのように表現されるかを改善することで、多様性を向上させます。

StyleGAN 2 と StyleGAN 3 の比較: 主な改善点と相違点

NVIDIAは、StyleGAN 2とStyleGAN 3で大幅なアップデートを行うなど、長期にわたってStyleGANを改良してきました。StyleGAN 2では、ウェイトデモジュレーションと呼ばれる機能が追加され、画像がより鮮明に分離され、水滴の歪みなどの一般的な問題が軽減されました。また、画像にノイズを加える方法も改善され、より安定したリアルな結果が得られるようになりました。しかし、いくつかの問題はまだ残っており、特にテクスチャやディテールが顔に「くっついている」ように見え、以下のbycloudの動画で紹介しているようなエイリアシングの問題も発生していました:

StyleGAN 3 では、フーリエの特徴量を導入し、潜在的な空間遷移の滑らかさを大幅に改善することで、これらの問題に対処しました。特徴量が特定のピクセルグリッドに固定されていた StyleGAN 2 とは異なり、StyleGAN 3 では回転や平行移動などの変換がスムーズに行われるようになりました。そのため、オブジェクトが急激に歪むことなく、より自然に動くため、アニメーションや動画生成に特に適しています。StyleGAN 3 は流動的な動きを必要とするアプリケーションに適していますが、StyleGAN 2 はその効率性の高さと広く採用されていることから、高品質な静止画像生成のための一般的な選択肢となっています。

AI、コンピュータヴィジョン、画像生成におけるStyleGANの応用

StyleGANは多くの業界で使用されており、アート、エンターテイメント、ヘルスケア、小売などの分野でAI生成コンテンツの使用方法を変えています。リアルでカスタマイズ可能な画像を作成できるため、クリエイティブなプロジェクトでも実用的な用途でも、強力なツールとなります。

AI 生成のアートとデザイン

アーティストやデザイナーは StyleGAN を使用して、異なるスタイルをスムーズに組み合わせることで、ユニークなイメージやデジタルポートレート、コンセプトアートを制作しています。細かなディテールを調整し、ハイクオリティな画像を作成できるこのモデルは、夢のようなアートワークからリアルなイラストまで、クリエイティブな可能性を無限に広げます。

医療画像と研究

StyleGANは、実際の医療データが限られていたり、機密性が高すぎて共有できない場合に、AIモデルの学習に役立つ人工的な医療画像を作成するために、医学研究に使用されています。現実的でありながら匿名性の高いデータセットを生成することで、研究者は患者のプライバシーを保護しながら、病気を診断するためのAIを改善することができます。

ファッションとEコマース

StyleGANは、リアルな商品画像、バーチャルモデルによる試着、AIを活用した試着ツールなどを作成することで、ファッション・小売業界をサポートしています。ブランドはこのテクノロジーを使って、顧客にカスタマイズされたショッピング体験を提供し、実物のサンプルを必要とせずに衣服やアクセサリーの実物そっくりのプレビューを確認できるようにしています。

StyleGANによる生成AIの課題と今後の方向性

StyleGANは、AIが生成する画像の大きな飛躍的進歩ですが、研究者や開発者が解決に取り組んでいる課題がまだあります。これらの課題には、倫理的な懸念や、生成された画像を人々がどの程度簡単に使用し、制御できるかといった技術的な制限まで多岐にわたります。

倫理的懸念と悪用

StyleGANの大きな懸念のひとつは、ディープフェイクによって生成されたコンテンツが、偽情報の拡散や身元の詐称に悪用される可能性があることです。技術が進歩すればするほど、本物の画像と偽物の画像を見分けるのは難しくなります。このため、エンターテインメントや研究における合法的な利用を認めつつ、有害な利用を阻止するための強力なAI倫理規則、検知システム、政策を求める声が高まっています。

高額の演算コスト

StyleGANモデルのトレーニングには、強力なGPUと大規模なデータセットが必要なため、コストがかかり、多くのリソースを必要とします。そのため、大手ハイテク企業や研究機関のみが簡単に利用でき、小規模な組織や独立系クリエイターはその可能性をフルに利用できずに苦労しています。研究者たちは、モデルの圧縮やコストの削減など、トレーニングをより効率的にする方法を研究しており、将来的にはより多くの人々がStyleGANを利用できるようになるでしょう。

データセットに多様性がない

StyleGANの学習に使われるデータには偏りがあることが多く、その結果、生成される画像の多様性が不足することがあります。例えば、特定の人種や性別の画像ばかりを使って学習させると、他の人種や性別のリアルな画像をうまく作れなくなる可能性があります。この問題を解決するために、研究者たちはより公平な学習方法を開発したり、バランスの取れたデータを集めたり、偏りを減らす工夫をしたりしています。これによって、AIが作り出す画像が、より多くの人々を正しく反映したものになるように改善しようとしています。

リアリズムとコントロールの両立

StyleGANには、「リアルな画像を作ること」と「ユーザーが細かくコントロールできること」を両立させるのが難しいという課題があります。モデルが進化してより自然な画像を作れるようになると、特定の要素(例えば年齢や表情)だけを変えようとしたときに、他の部分まで意図せず変わってしまうことがあります。これを解決するために、研究者たちはより使いやすい編集ツールや、画像の特徴をより細かく分けて調整できる技術の開発を進めています。これにより、年齢や表情、背景など特定の部分だけを変更しても、全体のバランスを崩さずに自然な画像を作れるようにすることが目指されています。

今すぐ登録して、$50分の無料クレジットをゲット!